Float:Right, 온디바이스 AI 모델 탑재 버전 정식 출시

플로트, Float:Right에 온디바이스 AI 자동 태깅 탑재…"인터넷 없이도 메모 정리 가능"

플로트 주식회사(Float Co., Ltd.)는 자사의 미니멀 AI 워크스페이스 'Float:Right'에 온디바이스 AI 자동 태깅 모델을 탑재한 정식 버전을 6일 출시했다고 밝혔다. 이번 업데이트의 핵심은 인터넷 연결이 없는 완전한 오프라인 환경에서도 메모를 작성하는 즉시 AI가 문맥을 파악해 관련 태그를 자동 생성·분류해주는 기능이다.

1,200만 건의 자체 데이터로 학습한 전용 태깅 모델

이번에 탑재된 온디바이스 모델은 단순히 기존 오픈소스 모델을 가져다 쓴 것이 아니다. 플로트가 자사 서비스 운영 과정에서 축적해 온 약 1,200만 건의 고유 데이터를 기반으로 SFT(Supervised Fine-Tuning) 방식으로 정밀 학습시킨 결과물이다. 실제 사용자들이 작성한 메모의 문맥, 키워드 패턴, 카테고리 분포 등을 반영하여 일반적인 텍스트 분류 모델과는 차별화된 태그 생성 품질을 확보했다.

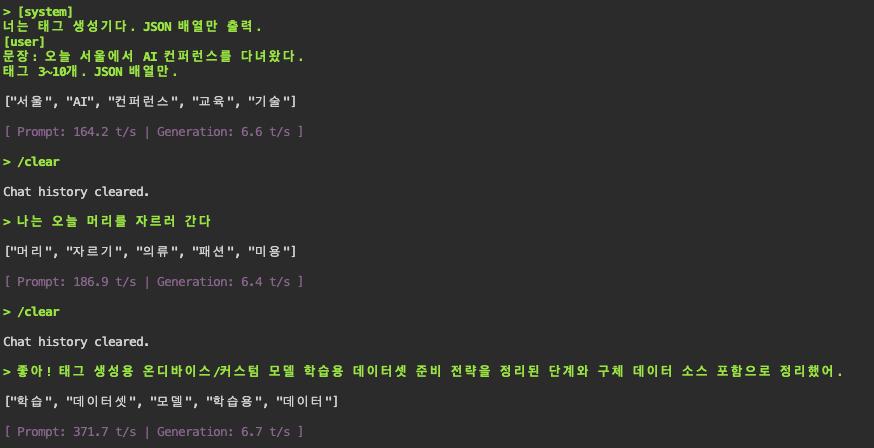

예를 들어 "오늘 서울에서 AI 컨퍼런스를 다녀왔다"라는 문장을 입력하면 ["서울", "AI", "컨퍼런스", "교육", "기술"]과 같이 문맥에 적합한 태그를 JSON 배열 형태로 즉시 출력한다. "나는 오늘 머리를 자르러 간다" 같은 일상적 메모에도 ["머리", "자르기", "의류", "패션", "미용"]처럼 의미 연관 태그를 빠르게 생성해내며, 온디바이스 환경에서도 Prompt 처리 164~371 t/s, Generation 6.4~6.7 t/s 수준의 실용적인 속도를 보여준다.

Qwen 기반·EXAONE 기반 다중 모델 라인업

Float:Right에서 선택할 수 있는 태깅 모델은 크게 두 계열이다. Qwen3 기반의 qwen3-0.6b-float-right-tagger는 0.8B 파라미터의 초경량 구조로 빠른 응답 속도가 강점이며, Safetensors 포맷의 원본 모델과 GGUF 양자화 버전을 모두 제공한다. EXAONE 4.0 기반의 exaone-4.0-1.2b-float-right-tagger는 1B 파라미터 규모로, 특히 짧은 한국어 입력에서의 태그 생성 정확도에 초점을 맞춘 모델이다. 역시 원본과 GGUF 버전이 모두 공개되어 있다.

EXAONE GGUF 변환 모델도 다수 공개

플로트는 태깅 전용 모델 외에도 LG AI Research의 EXAONE 시리즈를 GGUF 포맷으로 변환한 모델들을 다수 허깅페이스에 공개하고 있다. EXAONE-3.5-2.4B-Instruct-GGUF(2B), EXAONE-3.5-7.8B-Instruct-GGUF(8B), EXAONE-3.5-32B-Instruct-GGUF(32B)의 Instruct 계열과 EXAONE-Deep-2.4B-GGUF, EXAONE-Deep-7.8B-GGUF, EXAONE-Deep-32B-GGUF의 Deep 계열까지 총 6개 사이즈의 GGUF 변환 모델을 배포 중이며, 각 모델은 공개 이후 수백 건의 다운로드를 기록하고 있다. 이는 국내 개발자 커뮤니티에서 EXAONE 모델을 로컬 환경에서 손쉽게 구동하고자 하는 수요에 부응한 것으로 평가된다.

국가 첨단 GPU 인프라가 만든 성과

이들 모델의 파인튜닝은 과학기술정보통신부·정보통신산업진흥원(NIPA) 주관 '첨단 GPU 활용 지원사업'을 통해 확보한 국가 AI 컴퓨팅 인프라 위에서 이루어졌다. 플로트는 지난 2월 베타서비스 대상 기업으로 선정된 이후 고성능 GPU 클러스터를 집중 활용하여 1,200만 건 규모의 데이터셋 전처리부터 다양한 하이퍼파라미터 실험, 최종 모델 양자화까지를 단기간 내에 완수했다. RIDM.AI 서비스에서도 응답 생성 품질 향상을 위한 여러 실험을 병행하여 유의미한 성과를 거둔 것으로 알려졌다.

macOS 우선 출시, 멀티 플랫폼 순차 확대

정식 출시는 macOS 버전을 우선으로 진행되며, Windows, iOS, Android 버전은 순차적으로 출시될 예정이다. macOS 환경에서는 Apple Silicon의 Neural Engine과 결합하여 온디바이스 추론 성능이 더욱 최적화된 경험을 제공한다고 플로트 측은 설명했다.

허깅페이스에 전량 오픈소스 공개

플로트는 이번에 개발한 모든 모델을 오픈소스 AI 허브인 허깅페이스(Hugging Face)의 FloatDo 조직 페이지에 공개했다. Float:Right 태깅 전용 모델은 Apache-2.0 라이선스로 배포되어 누구나 자유롭게 활용·수정·재배포할 수 있으며, GGUF 포맷 제공으로 llama.cpp, Ollama 등 다양한 로컬 추론 엔진에서 바로 구동할 수 있다.

📦 공개 모델 목록 (Hugging Face — FloatDo)

· qwen3-0.6b-float-right-tagger — Safetensors, 0.8B

· qwen3-0.6b-float-right-tagger-GGUF — GGUF 양자화, 0.8B

· exaone-4.0-1.2b-float-right-tagger — Safetensors, 1B

· exaone-4.0-1.2b-float-right-tagger-GGUF — GGUF 양자화, 1B

· EXAONE-3.5-2.4B-Instruct-GGUF — 2B

· EXAONE-3.5-7.8B-Instruct-GGUF — 8B

· EXAONE-3.5-32B-Instruct-GGUF — 32B

· EXAONE-Deep-2.4B-GGUF — 2B

· EXAONE-Deep-7.8B-GGUF — 8B

· EXAONE-Deep-32B-GGUF — 32B

장청일 플로트 대표는 "Float:Right의 핵심 가치는 '흐름을 끊지 않는 것'"이라며, "1,200만 건의 실사용 데이터로 학습시킨 온디바이스 모델 덕분에 비행기 안에서든, 지하철에서든, 네트워크가 없는 어떤 환경에서든 메모를 쓰는 순간 AI가 즉시 정리해주는 경험이 가능해졌다"고 전했다. 이어 "국가 첨단 GPU 지원사업이 스타트업의 AI 기술 자립에 실질적 도움이 되었고, 학습에 사용된 모델과 기술을 오픈소스로 환원하는 것이 생태계 전체에 기여하는 길이라 생각한다"고 덧붙였다.